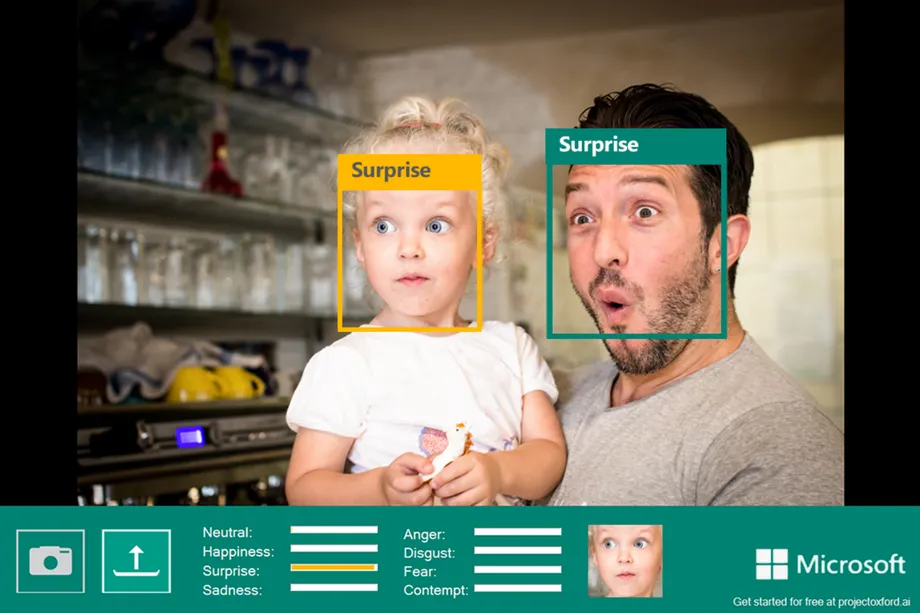

Microsoft postepeno ukida javni pristup brojnim alatima za analizu lica koje pokreće veštačka inteligencija – uključujući i onaj koji može da identifikuje emocije subjekta iz video zapisa i slika, budući da je „prepoznavanje emocija“ koje pokreće veštačka inteligencija kritikovano je kao nenaučno i nebezbedno.

Stručnjaci su kritikovali takve alate za „prepoznavanje emocija“. Kako kažu, ne samo da se izrazi lica za koje se smatra da su univerzalni razlikuju među različitim populacijama, već da je nenaučno izjednačavati spoljašnje ispoljavanje emocija sa unutrašnjim osećanjima.

„Kompanije mogu da kažu šta god žele, ali podaci su jasni“, rekla je Liza Feldman Baret, profesorka psihologije na Univerzitetu Northeastern, koja je sprovela pregled na temu prepoznavanja emocija pomoću veštačke inteligencije. „One mogu da otkriju mrštenje, ali to nije isto što i otkrivanje besa.”

„AI MOŽE DA DETEKTUJE MRŠTENJE, ALI TO NIJE ISTA STVAR KAO I OTKRIVANJE GNEVA.“

Ova odluka je deo veće revizije Microsoftovih etičkih politika o veštačkoj inteligenciji. Ažurirani standardi kompanije naglašavaju odgovornost da se otkrije ko koristi njene usluge i da se pojača kontrola i nadzor nad primenom tih alata.

U praksi, to znači da će Microsoft ograničiti pristup nekim funkcijama svojih usluga za prepoznavanje lica (poznatih kao Azure Face) i u potpunosti ukloniti druge. Korisnici će morati da se prijave da koriste Azure Face za identifikaciju lica, na primer, govoreći Microsoftu tačno kako i gde će primeniti svoje sisteme. Neki slučajevi korišćenja sa manje štetnog potencijala (poput automatskog zamućenja lica na slikama i video snimcima) će ostati otvoreni.

Pored uklanjanja javnog pristupa svom alatu za prepoznavanje emocija, Microsoft takođe povlači Azure Face-ovu sposobnost da identifikuje „atribute kao što su pol, starost, osmeh, dlake na licu, kosa i šminka“.

Pored uklanjanja javnog pristupa svom alatu za prepoznavanje emocija, Microsoft takođe povlači Azure Face-ovu sposobnost da identifikuje „atribute kao što su pol, starost, osmeh, dlake na licu, kosa i šminka“.

„Stručnjaci unutar i izvan kompanije istakli su nedostatak naučnog konsenzusa o definiciji ’emocija’, izazove u tome kako se zaključci generalizuju u slučajevima upotrebe, regionima i demografskim kategorijama, kao i povećanu zabrinutost za privatnost u vezi sa ovom vrstom mogućnosti“, napisala je Majkrosoftov glavni odgovorni službenik za veštačku inteligenciju, Nataša Krempton.

Microsoft kaže da će prestati da nudi ove funkcije novim korisnicima 21. juna 2022, dok će postojećim korisnicima pristup biti ukinut 30. juna 2023.

MICROSOFTOVA APLIKACIJA „SEEING AI“ I dalje će nuditi PREPOZNAVANJE EMOCIJA

Međutim, dok Microsoft povlači javni pristup ovim funkcijama, nastaviće da ih koristi u najmanje jednom od svojih proizvoda: aplikaciji pod nazivom Seeing AI koja koristi mašinski vid da opiše svet za ljude sa oštećenjem vida.

U postu na blogu, Microsoftov glavni menadžer proizvoda grupe za Azure AI, Sarah Bird, rekla je da alati kao što je prepoznavanje emocija „mogu biti dragoceni kada se koriste za one scenarije kojima je mogući iskoordinirati kontrolu pristupačnosti“. Nije jasno da li će se ovi alati koristiti u nekim drugim Microsoft proizvodima.

Microsoft takođe uvodi slična ograničenja za svoju funkciju Custom Neural Voice, koja omogućava korisnicima da kreiraju glasove veštačke inteligencije na osnovu snimaka stvarnih ljudi (ponekad poznatih kao audio fake).

Alat „ima uzbudljiv potencijal u obrazovanju, pristupačnosti i zabavi“, piše Bird, ali ona napominje da je „takođe lako zamisliti kako se može koristiti za neprikladno lažno predstavljanje govornika i obmanjivanje slušalaca“. Microsoft kaže da će u budućnosti ograničiti pristup ovoj funkciji na „upravljane klijente i partnere“ i „obezbediti aktivno učešće govornika prilikom kreiranja sintetičkog glasa“.

DA LI JE veštačka inteligencija ZAISTA u stanju da prepozna emocije ljudi?

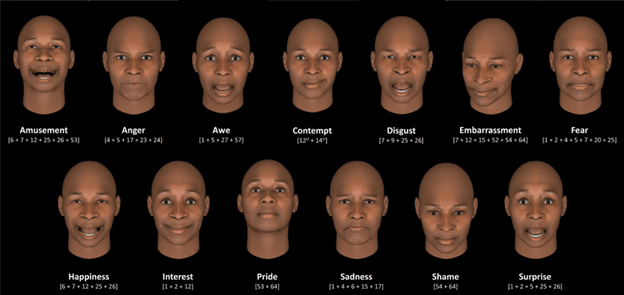

Međunarodni tim naučnika otkrio je sposobnost veštačke inteligencije da odredi ljudske emocije. Analizirali su fotografije glumaca da vide da li izrazi lica tačno oslikavaju osećanja. Ispostavilo se da ljudi koriste različite pokrete lica da prenesu iste emocije ili isti izraz lica za različite emocije. Na primer, jedna osoba može da se namršti kada je ljuta, dok druga može širom otvoriti oči ili se čak smejati, a neka će biti namrštena ne zato što je ljuta već samo zabrinuta ili tužna.

Studija je takođe pokazala da ljudi koriste iste gestove da prenesu različite emocije, kao što su mrštenje da bi izrazili bes, ali mrštenjem se može izraziti negodovanje, nezadovoljstvo, tuga i lsično.

Dakle AI može „naslutiti“ unutrašnje stanje – emocije, na osnovu facijalne ekspresije koja jeste pokazatelj ali ne i validan dokaz koji pokazuje šta vi iznutra osećate.

Tokom eksperimenata, naučnici su fotografisali profesionalne glumce u određenim emocionalnim stanjima. Svaki od scenarija je analiziran u dve odvojene studije.

U prvom, 839 volontera je ocenilo stepen do kojeg opisi situacija izazivaju jednu od 13 emocija. Istraživači su zatim izračunali prosečnu ocenu svakog scenarija, podelili ih u kategorije i koristili model mašinskog učenja da analiziraju izraze lica glumaca na fotografijama.

Ispostavilo se da su glumci koristili različite izraze lica da bi prikazali ista stanja. Analiza je takođe pokazala da slični položaji ne mogu pouzdano da izraze istu emocionalnu kategoriju.

Istraživači su zatim zamolili dodatne grupe dobrovoljaca da procene izraze lica svakog pojedinca posebno.

Otkrili su da samo prrocenjivanje izraza lica nije često nije u skladu sa procenama emocija kada se razmatraju u kombinaciji sa scenarijima.

Koautor studije Lisa Feldman Baret rekla je da rezultati dovode u sumnju uobičajene tvrdnje o emocionalnoj veštačkoj inteligenciji.

„Neke kompanije tvrde da imaju algoritme koji mogu, na primer, da otkriju bes, dok u stvari – pod optimalnim okolnostima – imaju algoritme koji će verovatno otkriti mrštenje, koje može, ali ne mora biti izraz besa“

Baret je dodala da je važno ne mešati opis konfiguracije lica sa zaključcima o njegovom emocionalnom stanju.